Iarna trecută, în timpul construcției unui proiect de locuințe accesibile în Martha's Vineyard, Massachusetts, un muncitor în vârstă de 32 de ani pe nume Jose Luis Collaguazo Crespo a alunecat de pe o scară la etajul doi și s-a prăbușit spre moarte în subsol. El a fost unul dintre mai mulți decât 1.000 de muncitori în construcții care mor la locul de muncă în fiecare an în SUA, făcându-l cel mai periculos industrie pentru alunecări, împiedicări și căderi fatale.

„Toată lumea vorbește despre cum «siguranța este prioritatea numărul unu»”, a declarat antreprenorul și directorul executiv Philip Lorenzo în timpul unei prezentări la Ziua Inovării în Construcții 2025, o conferință organizată la Universitatea din California, Berkeley, în aprilie. „Dar poate că, pe plan intern, nu este o prioritate atât de mare. Oamenii iau scurtături pe șantiere. Și astfel există această luptă între... siguranță și productivitate.”

Pentru a combate scurtăturile și asumarea riscurilor, Lorenzo lucrează la un instrument pentru compania DroneDeploy, cu sediul în San Francisco., care vinde software ce creează zilnic modele digitale ale progresului muncii din videoclipuri și imagini, cunoscute în domeniu sub numele de „captură de realitate”. Instrumentul, numit Safety AI, analizează imaginile de captură a realității din fiecare zi și semnalează condițiile care încalcă Administrația pentru Securitate și Sănătate în Muncă (OSHA) reguli, cu ceea ce el susține că este o precizie 95%. Aceasta înseamnă că, pentru orice risc de siguranță semnalat de software, există certitudinea 95% că semnalizarea este corectă și se referă la o reglementare OSHA specifică. Lansat în octombrie 2024, acesta este acum implementat pe sute de șantiere din SUA, spune Lorenzo, și au fost implementate și versiuni specifice reglementărilor în construcții din țări precum Canada, Marea Britanie, Coreea de Sud și Australia.

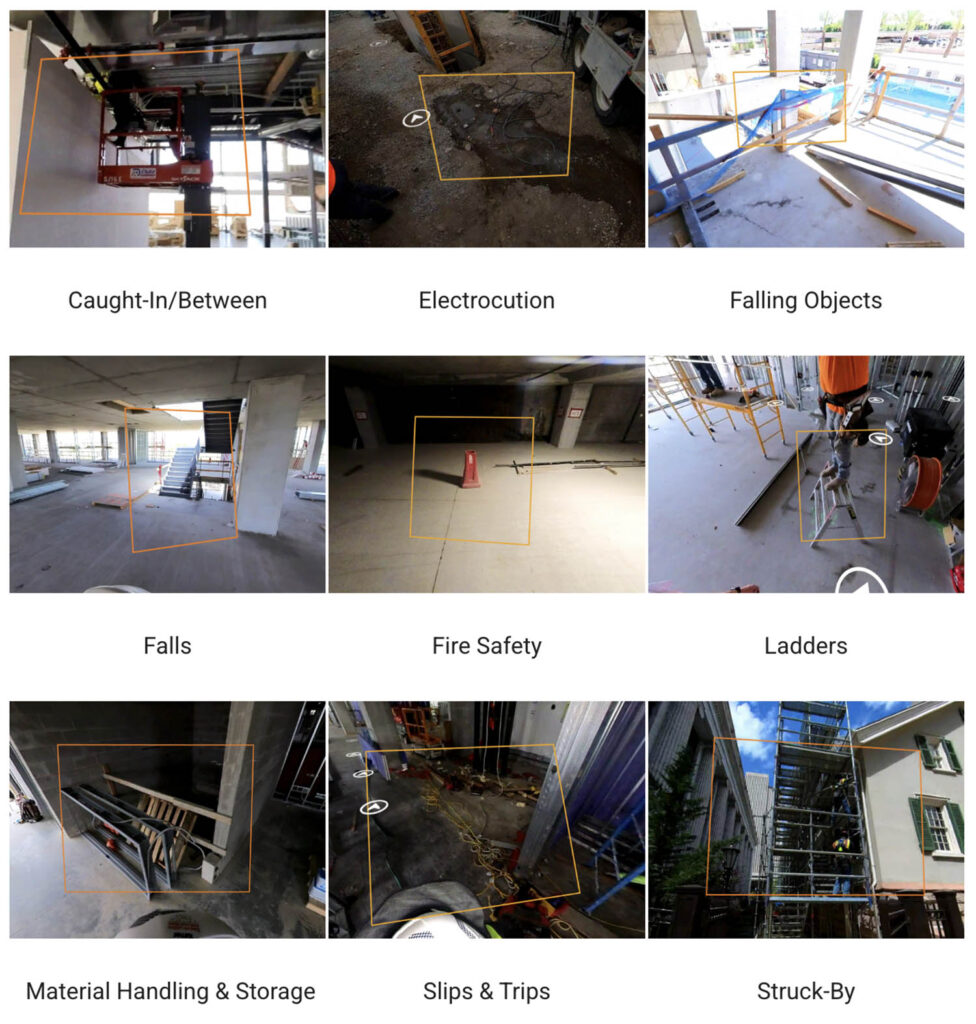

Siguranța prin inteligență artificială este unul dintre multiplele instrumente de siguranță în construcții cu inteligență artificială care au apărut în ultimii ani, de la Silicon Valley la Hong Kong la IerusalimMulte dintre acestea se bazează pe echipe de „clickeri” umani, adesea în țări cu salarii mici, pentru a trasa manual chei de delimitare în jurul imaginilor obiectelor cheie, cum ar fi scările, pentru a eticheta volume mari de date în vederea antrenării unui algoritm. Lorenzo spune că inteligența artificială pentru siguranță este prima companie care utilizează inteligența artificială generativă pentru a semnala încălcările normelor de siguranță, ceea ce înseamnă un algoritm care poate face mai mult decât să recunoască obiecte precum scări sau căști de protecție. Software-ul poate „raționa” despre ceea ce se întâmplă într-o imagine a unui șantier și poate trage o concluzie despre existența unei încălcări OSHA. Aceasta este o formă de analiză mai avansată decât detectarea obiectelor, care este standardul actual al industriei, susține Lorenzo. Dar, așa cum sugerează rata de succes a proiectului 95%, inteligența artificială pentru siguranță nu este o inteligență impecabilă și omniscientă. Necesită un inspector de siguranță cu experiență ca supraveghetor.

Un model de limbaj vizual în lumea reală

Roboții și inteligența artificială tind să prospere în medii controlate, în mare parte statice, cum ar fi podelele fabricilor sau terminalele maritime. Însă șantierele de construcții, prin definiție, se schimbă puțin în fiecare zi.

Lorenzo crede că a construit o metodă mai bună de monitorizare a amplasamentelor, folosind un tip de inteligență artificială generativă numită model de limbaj vizual sau VLM. Un VLM este un LLM cu un codificator vizual, care îi permite să „vadă” imagini ale lumii și să analizeze ce se întâmplă în scenă.

Folosind ani de experiență în imagini reale colectate de la clienți, cu permisiunea lor explicită, echipa lui Lorenzo a adunat ceea ce el numește un „set de date de aur” care cuprinde zeci de mii de imagini cu încălcări ale OSHA. După ce a stocat cu grijă aceste date specifice timp de ani de zile, nu este îngrijorat că nici măcar un gigant tehnologic de miliarde de dolari va putea să-l „copieze și să-l zdrobească”.

Pentru a ajuta la antrenarea modelului, Lorenzo are o echipă mai mică de experți în siguranța în construcții care pun întrebări strategice inteligenței artificiale. Instructorii introduc scene de test din setul de date de referință în VLM și pun întrebări care ghidează modelul prin procesul de descompunere a scenei și de analiză pas cu pas a acesteia, așa cum ar face-o o persoană experimentată. Dacă VLM nu generează răspunsul corect - de exemplu, ratează o încălcare sau înregistrează un rezultat fals pozitiv - instructorii umani revin și modifică solicitările sau intrările. Lorenzo spune că, în loc să învețe pur și simplu să recunoască obiectele, VLM este învățat „cum să gândească într-un anumit fel”, ceea ce înseamnă că poate trage concluzii subtile despre ceea ce se întâmplă într-o imagine.

De exemplu, Lorenzo spune că VLM-urile sunt mult mai bune decât metodele mai vechi pentru analizarea utilizării scării, care este responsabilă pentru 24% dintre decesele din toamnă în industria construcțiilor.

„Cu învățarea automată tradițională, este foarte dificil să răspunzi la întrebarea «Folosește o persoană o scară în mod nesigur?»”, spune Lorenzo. „Poți găsi scările. Poți găsi oamenii. Dar să raționezi logic și să spui «Ei bine, acea persoană este bine» sau «Oh, nu, acea persoană stă pe ultima treaptă» - numai VLM-ul poate raționa logic și apoi să spună: «Bine, este nesigur. Și iată referința OSHA care spune că nu poți fi pe ultima treaptă.»”

Răspunsuri la întrebări multiple (Are persoana de pe scară trei puncte de contact? Sunt ele folosind scara pe post de pilot pentru a te deplasa?) sunt combinate pentru a determina dacă scara din imagine este utilizată în siguranță. „Sistemul nostru are peste o duzină de niveluri de întrebări doar pentru a ajunge la acel răspuns”, spune Lorenzo. DroneDeploy nu și-a publicat datele pentru revizuire, dar spune că speră ca metodologia sa să fie auditată independent de experți în siguranță..

5% dispărut

Utilizarea modelelor de limbaj vizual pentru inteligența artificială în construcții este promițătoare, dar există „câteva probleme destul de fundamentale” de rezolvat, inclusiv halucinațiile și problema cazurilor limită, acele pericole anormale pentru care VLM nu a fost antrenat, spune Chen Feng. El conduce Laboratorul AI4CE al Universității din New York, care dezvoltă tehnologii pentru cartografierea 3D și înțelegerea scenei în robotica de construcții și în alte domenii. „Nouăzeci și cinci la sută este încurajator - dar cum remediem acel 5% rămas?”, întreabă el despre rata de succes a Safety AI. Feng face referire la o lucrare din 2024 intitulată „Ochii larg închiși?” — scris de Shengbang Tong, doctorand la NYU, și co-autorat de vedeta inteligenței artificiale Yann LeCun — care a menționat „deficiențe sistematice” ale VLM-urilor. „Pentru detectarea obiectelor, acestea pot atinge destul de bine performanțe la nivel uman”, spune Feng. „Cu toate acestea, pentru lucruri mai complicate — aceste capacități trebuie încă îmbunătățite.” El observă că VLM-urile s-au chinuit să interpreteze structura scenelor 3D din imagini 2D, nu au o bună conștientizare situațională în raționamentul despre relațiile spațiale și adesea le lipsește „bunul simț” în ceea ce privește scenele vizuale.

Lorenzo recunoaște că există „câteva defecte majore” ale modelelor de învățare automată (LLM) și că acestea au dificultăți cu raționamentul spațial. Așadar, Safety AI folosește și unele metode mai vechi de învățare automată pentru a ajuta la crearea de modele spațiale ale șantierelor de construcții. Aceste metode includ segmentarea imaginilor în componente cruciale și fotogrametria, o tehnică consacrată pentru crearea unui model digital 3D dintr-o imagine 2D. Safety AI s-a antrenat intens și în... 10 zone problematice diferite, inclusiv utilizarea scării, pentru a anticipa cele mai frecvente încălcări.

Chiar și așa, Lorenzo recunoaște că există cazuri limită pe care LLM-ul nu le va putea recunoaște. Dar el observă că pentru managerii de siguranță suprasolicitați, care sunt adesea responsabili pentru până la 15 locații simultan, a avea o pereche suplimentară de „ochi” digitali este totuși o îmbunătățire.

Aaron Tan, manager de proiecte din domeniul betonului, cu sediul în zona golfului San Francisco, spune că un instrument precum Safety AI ar putea fi util pentru acești manageri de siguranță suprasolicitați, care vor economisi mult timp dacă pot primi o alertă prin e-mail, în loc să fie nevoiți să facă o călătorie de două ore cu mașina pentru a vizita personal un șantier. Și dacă software-ul poate demonstra că ajută la menținerea siguranței oamenilor, el crede că lucrătorii îl vor adopta în cele din urmă.

Totuși, Tan observă că lucrătorii se tem și că aceste tipuri de unelte vor fi „„bossware” folosit pentru a-i băga în bucluc„La ultima mea companie, am implementat camere video [ca] sistem de securitate. Și băieților nu le-a plăcut asta”, spune el. „Au fost de genul: «O, Frate Mai Mare. Voi mă urmăriți mereu - nu am intimitate.»”

Mai vechi nu înseamnă învechit

Izhak Paz, CEO al unei companii cu sediul în Ierusalim numită Safeguard AI, a luat în considerare încorporarea VLM-urilor, dar a rămas la paradigma mai veche de învățare automată, deoarece o consideră mai fiabilă. „Vechea viziune computerizată” bazată pe învățarea automată „este și mai bună, deoarece este un hibrid între mașina în sine și intervenția umană în gestionarea abaterilor”, spune el. Pentru a antrena algoritmul pe o nouă categorie de pericol, echipa sa agregă un volum mare de imagini etichetate legate de pericolul specific și apoi optimizează algoritmul prin eliminarea rezultatelor fals pozitive și fals negative. Procesul poate dura de la săptămâni la peste șase luni, spune Paz. După finalizarea instruirii, Safeguard AI efectuează o evaluare a riscurilor pentru a identifica potențialele pericole de pe șantier. Poate „vedea” șantierul în timp real accesând imagini de la orice cameră conectată la internet din apropiere. Apoi folosește un agent AI pentru a transmite instrucțiuni despre ce trebuie făcut în continuare către dispozitivele mobile ale administratorilor de șantier. Paz refuză să ofere un preț precis, dar spune că produsul său este accesibil doar constructorilor de nivel „mediu” și superior, în special celor care gestionează mai multe șantiere. Instrumentul este utilizat în aproximativ 3.500 de locații din Israel, Statele Unite și Brazilia.

Buildots, o companie cu sediul în Tel Aviv care Revista Tehnologiei MIT profilat în 2020, nu face analize de siguranță, ci creează rapoarte vizuale de progres ale amplasamentelor o dată sau de două ori pe săptămână. Buildots folosește, de asemenea, metoda mai veche de învățare automată cu date de antrenament etichetate. „Sistemul nostru trebuie să fie 99% - nu putem avea halucinații”, spune CEO-ul Roy Danon. El spune că obținerea de date de antrenament etichetate este de fapt mult mai ușoară decât era atunci când el și cofondatorii săi au început proiectul în 2018, deoarece colectarea de înregistrări video ale amplasamentelor înseamnă că fiecare obiect, cum ar fi un socket, poate fi capturat și apoi etichetat în mai multe cadre diferite. Dar instrumentul este de ultimă generație - aproximativ 50 de constructori, majoritatea cu venituri de peste 14250 de milioane de dolari pe săptămână, utilizează Buildots în Europa, Orientul Mijlociu, Africa, Canada și SUA. A fost folosit în peste 300 de proiecte până acum.

Ryan Calo, specialist în robotică și legislație bazată pe inteligență artificială la Universitatea din Washington, apreciază ideea utilizării inteligenței artificiale pentru siguranța în construcții. Întrucât managerii de siguranță cu experiență sunt deja dispersați în domeniul construcțiilor, Calo se teme că constructorii vor fi tentați să automatizeze complet munca umană în procesul de siguranță. „Cred că inteligența artificială și dronele pentru detectarea problemelor de siguranță care altfel ar ucide lucrătorii sunt extrem de inteligente”, spune el. „Atâta timp cât sunt verificate de o persoană.”

Andrew Rosenblum este un jurnalist independent specializat în tehnologie, cu sediul în Oakland, California.